Na początku mojej kariery jako inżynier DevOps spędziłem miesiące na optymalizacji natywnej dla chmury architektury mikrousług dla firmy z branży produkcji mediów. Przeznaczaliśmy ogromne zasoby serwerowe na rozwiązanie jednego problemu: redukcję opóźnień w przetwarzaniu dźwięku. Rachunki z AWS były zawrotne, a infrastruktura niezwykle krucha. Patrząc z dzisiejszej perspektywy, gdy formalizujemy mapę drogową produktów na rok 2026 dla AI App Studio, cały ten scentralizowany model chmurowy wydaje się zamierzchłą przeszłością. Nie przesyłamy już danych na serwer; przesyłamy moc obliczeniową bezpośrednio do kieszeni użytkownika.

W swojej istocie, mapa drogowa produktu typu „hardware-first” to strategia rozwoju, która priorytetyzuje uruchamianie złożonych modeli bezpośrednio na lokalnych urządzeniach konsumenckich, zamiast polegać na zdalnych serwerach. Takie podejście zmusza nas do przemyślenia wszystkiego: od wdrażania mikrousług po ustalanie priorytetów funkcji. Jako studio oprogramowania skoncentrowane na technologii, które tworzy aplikacje mobilne z integracją sztucznej inteligencji, nasza mapa drogowa jest całkowicie podyktowana gwałtowną decentralizacją cyfrowych procesów pracy.

Dla zespołów inżynieryjnych i menedżerów produktu, którzy próbują odejść od silnej zależności od chmury, budowa zrównoważonego ekosystemu aplikacji wymaga strukturalnego podejścia. Oto ramy krok po kroku, których używamy do mapowania naszej długoterminowej wizji technicznej na rzeczywiste problemy użytkowników.

Krok 1: Śledzenie decentralizacji fizycznych miejsc pracy

Zanim napiszesz jakąkolwiek linię kodu, musisz zrozumieć, gdzie faktycznie pracuje Twój docelowy użytkownik. Tradycyjna definicja dedykowanego miejsca pracy upada. Według analiz branżowych Accio na rok 2026, szeroko pojęty rynek sprzętu audio i wideo ma osiągnąć wartość 21,46 miliarda dolarów, co jest napędzane głównie przez pracę hybrydową i zmiany wywołane przez AI. Jednocześnie Circular Studios poinformowało niedawno, że branża fizycznych studiów fotograficznych szybko migruje w stronę bezobsługowych modeli samoobsługowych, aby obniżyć koszty operacyjne i zapewnić dostępność 24/7.

Dane te ujawniają kluczowe spostrzeżenie: użytkownicy chcą profesjonalnych środowisk, ale nie chcą już kosztów związanych z ich zarządzaniem. Fizyczna lokalizacja ma znacznie mniejsze znaczenie niż wspierająca ją infrastruktura oprogramowania. Studio roku 2026 to nie fizyczne pomieszczenie z pianką akustyczną; to zdecentralizowany ekosystem oprogramowania działający na mobilnym sprzęcie krawędziowym (edge hardware).

Kiedy przestrzenie fizyczne stają się bezobsługowe, oprogramowanie musi przejąć rolę personelu administracyjnego i kreatywnego. Śledzimy te trendy w fizycznych branżach bardzo uważnie, ponieważ mówią nam one dokładnie, gdzie wkrótce pojawią się największe cyfrowe wyzwania.

Krok 2: Ustalenie lokalnych bazowych parametrów sprzętowych

Nie można zbudować wiarygodnej mapy drogowej przetwarzania krawędziowego bez wyznaczenia ścisłych ograniczeń sprzętowych. W architekturze chmurowej, jeśli proces jest zbyt ciężki, po prostu uruchamiasz kolejny kontener. W programowaniu mobilnym musisz pracować w granicach termicznych i bateryjnych fizycznego urządzenia w dłoni użytkownika.

Segmentujemy nasze cele optymalizacyjne na poszczególne generacje sprzętu, aby zapewnić stabilność:

- Baza Legacy: iPhone 11 pozostaje naszym minimum dla wielu podstawowych zadań lokalnych. Choć jego silnik neuronowy jest starszy, wciąż świetnie radzi sobie z podstawowym przetwarzaniem języka naturalnego w tle, bez konieczności interwencji chmury.

- Standard Core: Intensywnie optymalizujemy pod kątem układu A15 Bionic, znajdującego się w standardowym iPhonie 14 i iPhonie 14 Plus. Urządzenia te reprezentują ogromny rynek profesjonalnych użytkowników. Zapewniają wystarczający zapas termiczny, aby niezawodnie obsługiwać złożone parsowanie dokumentów i lokalne filtrowanie dźwięku.

- Advanced Edge: W przypadku zaawansowanego, obciążającego obliczeniowo renderowania, celujemy w możliwości iPhone'a 14 Pro. Zwiększona przepustowość pamięci i architektura procesora pozwalają nam uruchamiać modele multimodalne całkowicie offline, zastępując zadania, które wcześniej wymagały stacji roboczej.

Mapując funkcje oprogramowania bezpośrednio na te specyficzne możliwości krzemowe, unikamy pułapki tworzenia aplikacji, które drenują baterię lub zawieszają się pod obciążeniem.

Krok 3: Dopasowanie możliwości technicznych do codziennych problemów użytkowników

Częstą pułapką dla zespołów inżynieryjnych jest tworzenie funkcji tylko dlatego, że dany model ją wspiera. Silna mapa drogowa łączy wykonalność techniczną bezpośrednio z frustrującym wąskim gardłem użytkownika. Jak wspomniałem w moim poprzednim wpisie szczegółowo opisującym, jak budujemy mapy drogowe w oparciu o realne potrzeby użytkowników, każda aplikacja musi uzasadnić swoje istnienie poprzez usunięcie konkretnej bariery.

Oceniamy nowe aplikacje przy użyciu ścisłego schematu decyzyjnego:

- Redukcja opóźnień: Czy przeniesienie tego zadania z chmury na urządzenie oszczędza użytkownikowi zauważalny czas oczekiwania?

- Prywatność danych: Czy proces obejmuje wrażliwe dane klienta, które bezpieczniej jest przechowywać wyłącznie w lokalnej pamięci?

- Niezawodność offline: Czy użytkownik może ukończyć zadanie w miejscu o dużym zagęszczeniu (jak konferencja) lub o słabej łączności (jak sesja w terenie)?

Jeśli pomysł nie spełnia co najmniej dwóch z tych kryteriów, nie trafia do naszego harmonogramu produkcji. Budujemy narzędzia, aby rozwiązywać problemy, a nie by chwalić się algorytmami.

Krok 4: Eliminacja wąskich gardeł administracyjnych obok zadań kreatywnych

Podczas gdy media często skupiają się na generowaniu obrazów czy wideo, największym problemem dla niezależnych profesjonalistów jest zazwyczaj administracja. Zarządzanie zdecentralizowanym biznesem wymaga obsługi komunikacji z klientami, umów i harmonogramów bez bycia przywiązanym do biurka.

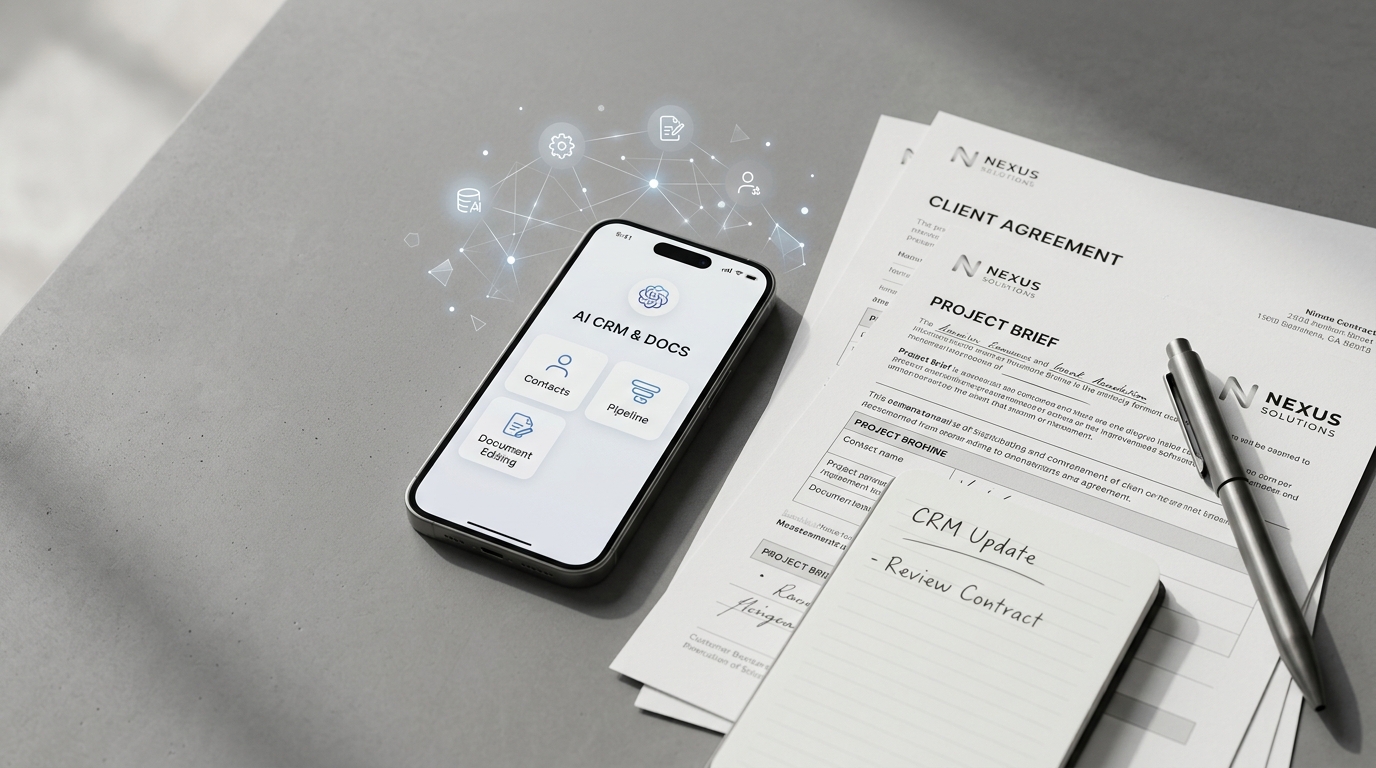

Na przykład, profesjonaliści mobilni często zmagają się z zarządzaniem dokumentami. Standardowy edytor PDF na telefonie jest zazwyczaj toporny i wymaga ręcznego zaznaczania tekstu lub formatowania. Dzięki integracji lokalnej inteligencji możemy opracować narzędzie mobilne, które automatycznie strukturyzuje dane z faktur lub wyodrębnia kluczowe klauzule umów lokalnie, utrzymując wrażliwe szczegóły finansowe z dala od zewnętrznych serwerów.

Podobnie, tradycyjne desktopowe narzędzia CRM są zbyt rozbudowane dla kogoś pracującego z urządzenia mobilnego. Lekki CRM działający na urządzeniu może kategoryzować przychodzące zapytania klientów i organizować pliki projektowe na podstawie lokalnego kontekstu. To właśnie mamy na myśli, mówiąc, że sprzęt wyprzedził oprogramowanie; urządzenia są zdolne do prowadzenia kompletnych operacji zaplecza biurowego, pod warunkiem, że architektura oprogramowania jest do tego przystosowana.

Krok 5: Przyjęcie odpornej, niezależnej od urządzenia architektury

Z perspektywy projektowania systemów, odejście od scentralizowanego przetwarzania w chmurze wymaga fundamentalnej zmiany w sposobie pisania oprogramowania. Musisz traktować aplikację mobilną nie jako cienkiego klienta przeglądającego stronę internetową, ale jako niezależny węzeł mikrousług.

Podczas wdrażania aktualizacji lub modyfikowania wag modeli używamy modułowych architektur. Zamiast zmuszać użytkowników do pobierania ogromnych, monolitycznych aktualizacji aplikacji, oddzielamy warstwę interfejsu użytkownika od silnika wnioskowania (inference engine). Pozwala to nam na wypychanie lekkich, celowanych ulepszeń do konkretnych modeli obsługujących zadania takie jak izolacja dźwięku czy kategoryzacja tekstu.

To podejście do rozwoju mobilnego, inspirowane metodologią DevOps, gwarantuje, że nasze aplikacje pozostają zwinne. Jak szczegółowo opisała moja koleżanka Bilge Kurt w swojej analizie tego, jak codzienny sprzęt mobilny zastępuje ciężkie procesy produkcyjne, efektywność jest kluczowym miernikiem dla nowej generacji studiów oprogramowania. Celem jest maksymalizacja wydajności przy jednoczesnym minimalizowaniu śladu aplikacji.

Krok 6: Planowanie długofalowej ekonomii przetwarzania krawędziowego

Ostatnim krokiem w planowaniu naszej mapy drogowej jest analiza długoterminowej ekonomii wdrażania oprogramowania. Koszty przetwarzania w chmurze rosną liniowo wraz ze wzrostem liczby użytkowników; im większy sukces odnosi Twoja aplikacja, tym wyższe są rachunki za serwery. Budując mapę drogową skoncentrowaną na przetwarzaniu na lokalnych urządzeniach, przełamujemy tę liniową krzywą kosztów.

Ta rzeczywistość ekonomiczna pozwala studiu pozostać zwinnym i niezależnym. Ponieważ nie dotujemy ogromnych farm serwerów, możemy przeznaczyć więcej zasobów inżynieryjnych na dopracowanie doświadczeń użytkownika i optymalizację kodu. Tworzy to zrównoważony cykl, w którym oprogramowanie staje się szybsze, prywatność pozostaje nienaruszona, a użytkownik zyskuje całkowitą kontrolę nad swoim codziennym środowiskiem cyfrowym.

Opracowanie mapy drogowej na rok 2026 i lata kolejne wymaga wyjścia poza bieżący cykl szumu medialnego. Oznacza to uznanie, że najcenniejszym oprogramowaniem nadchodzącej dekady będą narzędzia, które działają cicho, wydajnie i całkowicie w Twojej dłoni.