Zu Beginn meiner Karriere als DevOps-Engineer verbrachte ich Monate damit, eine Cloud-native Microservice-Architektur für ein Medienproduktionsunternehmen zu optimieren. Wir setzten massive Serverressourcen für ein einziges Ziel ein: die Reduzierung der Latenz bei der Audioverarbeitung. Die AWS-Rechnungen waren astronomisch, und die Infrastruktur war äußerst fragil. Wenn wir heute die Produkt-Roadmap für 2026 im AI App Studio konkretisieren, fühlt sich dieses gesamte zentralisierte Cloud-Modell wie Urzeit an. Wir schieben Daten nicht mehr hoch auf einen Server; wir bringen die Rechenleistung direkt in die Hosentasche des Nutzers.

Im Kern ist eine „Hardware-First“-Produkt-Roadmap eine Entwicklungsstrategie, die darauf setzt, komplexe Modelle direkt auf lokalen Endgeräten auszuführen, anstatt sich auf Remote-Server zu verlassen. Dieser Ansatz zwingt uns dazu, alles zu überdenken – vom Microservice-Deployment bis zur Priorisierung von Funktionen. Als technologieorientiertes Software-Studio, das mobile Anwendungen mit KI-Integration entwickelt, wird unsere Roadmap vollständig von der rasanten Dezentralisierung digitaler Workflows bestimmt.

Für Engineering-Teams und Produktmanager, die den Übergang weg von der starken Cloud-Abhängigkeit meistern wollen, erfordert der Aufbau eines nachhaltigen App-Ökosystems einen strukturierten Ansatz. Hier ist der schrittweise Rahmen, den wir nutzen, um unsere langfristige technische Vision mit realen Nutzerproblemen in Einklang zu bringen.

Schritt 1: Die Dezentralisierung physischer Arbeitsbereiche verfolgen

Bevor Sie auch nur eine Zeile Code schreiben, müssen Sie verstehen, wo der Zielnutzer tatsächlich arbeitet. Die traditionelle Definition eines dedizierten Arbeitsplatzes löst sich auf. Laut Branchenanalysen von Accio für das Jahr 2026 wird der Markt für Audio- und Video-Equipment voraussichtlich 21,46 Milliarden US-Dollar erreichen, was stark durch hybrides Arbeiten und KI-Veränderungen vorangetrieben wird. Gleichzeitig berichtete Circular Studios kürzlich, dass die Branche der physischen Fotostudios rasant auf unbemannte Self-Service-Modelle umstellt, um Betriebskosten zu senken und eine 24/7-Verfügbarkeit zu gewährleisten.

Diese Daten liefern eine entscheidende Erkenntnis: Nutzer wünschen sich professionelle Umgebungen, wollen aber nicht mehr den Aufwand für deren Verwaltung tragen. Der physische Standort spielt eine weit geringere Rolle als die unterstützende Software-Infrastruktur. Das Studio von 2026 ist kein physischer Raum mit Akustikschaum; es ist ein dezentrales Software-Ökosystem, das auf mobiler Edge-Hardware läuft.

Wenn physische Räume unbemannt werden, muss die Software einspringen und die Rolle des administrativen und kreativen Personals übernehmen. Wir beobachten diese Trends in der physischen Industrie genau, weil sie uns zeigen, wo digitale Reibungspunkte entstehen werden.

Schritt 2: Lokale Hardware-Baselines festlegen

Man kann keine zuverlässige Edge-Computing-Roadmap erstellen, ohne strikte Hardware-Einschränkungen festzulegen. In der Cloud-Architektur fährt man bei zu hoher Last einfach einen weiteren Container hoch. In der mobilen Entwicklung muss man innerhalb der thermischen Grenzen und der Akkukapazität des Geräts arbeiten, das der Nutzer in der Hand hält.

Wir segmentieren unsere Optimierungsziele über verschiedene Hardware-Generationen hinweg, um Stabilität zu gewährleisten:

- Die Legacy-Baseline: Das iPhone 11 bleibt unsere Mindestanforderung für viele grundlegende lokale Aufgaben. Obwohl seine Neural Engine älter ist, ist sie immer noch in der Lage, einfaches Natural Language Processing im Hintergrund zu bewältigen, ohne die Cloud zu beanspruchen.

- Der Core-Standard: Wir optimieren massiv für den A15 Bionic Chip des iPhone 14 und iPhone 14 Plus. Diese Geräte repräsentieren den riesigen Mittelmarkt professioneller Nutzer. Sie bieten genug thermischen Spielraum, um komplexe Dokumentenanalysen und lokale Audiofilter zuverlässig auszuführen.

- Die Advanced Edge: Für High-End-Rendering mit hohem Rechenbedarf zielen wir auf die Fähigkeiten des iPhone 14 Pro ab. Die verbesserte Speicherbandbreite und Prozessorarchitektur erlauben es uns, multimodale Modelle komplett offline laufen zu lassen und Aufgaben zu ersetzen, die früher eine Desktop-Workstation erforderten.

Indem wir Software-Funktionen direkt diesen spezifischen Chip-Kapazitäten zuordnen, vermeiden wir die Falle, Anwendungen zu bauen, die den Akku leeren oder unter Last abstürzen.

Schritt 3: Technische Möglichkeiten mit täglichen Workflow-Hürden verknüpfen

Eine häufige Falle für Engineering-Teams besteht darin, ein Feature nur deshalb zu bauen, weil das zugrunde liegende Modell es unterstützt. Eine starke Roadmap verbindet die technische Machbarkeit direkt mit einem frustrierenden Nutzerengpass. Wie ich bereits in meinem Beitrag darüber erläutert habe, wie wir Roadmaps basierend auf echten Nutzerbedürfnissen erstellen, muss jede Anwendung ihre Existenz dadurch rechtfertigen, dass sie eine spezifische Barriere aus dem Weg räumt.

Wir bewerten neue Anwendungen anhand eines strengen Entscheidungsrahmens:

- Latenzreduzierung: Spart die Verlagerung dieser Aufgabe von der Cloud auf das Gerät dem Nutzer spürbare Wartezeit?

- Datenschutz: Beinhaltet der Workflow sensible Kundendaten, die auf dem lokalen Speicher sicherer aufgehoben sind?

- Offline-Zuverlässigkeit: Kann der Nutzer die Aufgabe auch an Orten mit hoher Netzauslastung (wie Konferenzen) oder schlechter Verbindung (wie bei einem Remote-Shooting) erledigen?

Wenn eine Idee nicht mindestens zwei dieser Kriterien erfüllt, landet sie nicht in unserem Produktionsplan. Wir bauen Werkzeuge, um Reibungsverluste zu lösen, nicht um Algorithmen zur Schau zu stellen.

Schritt 4: Administrative Engpässe parallel zu kreativen Aufgaben beheben

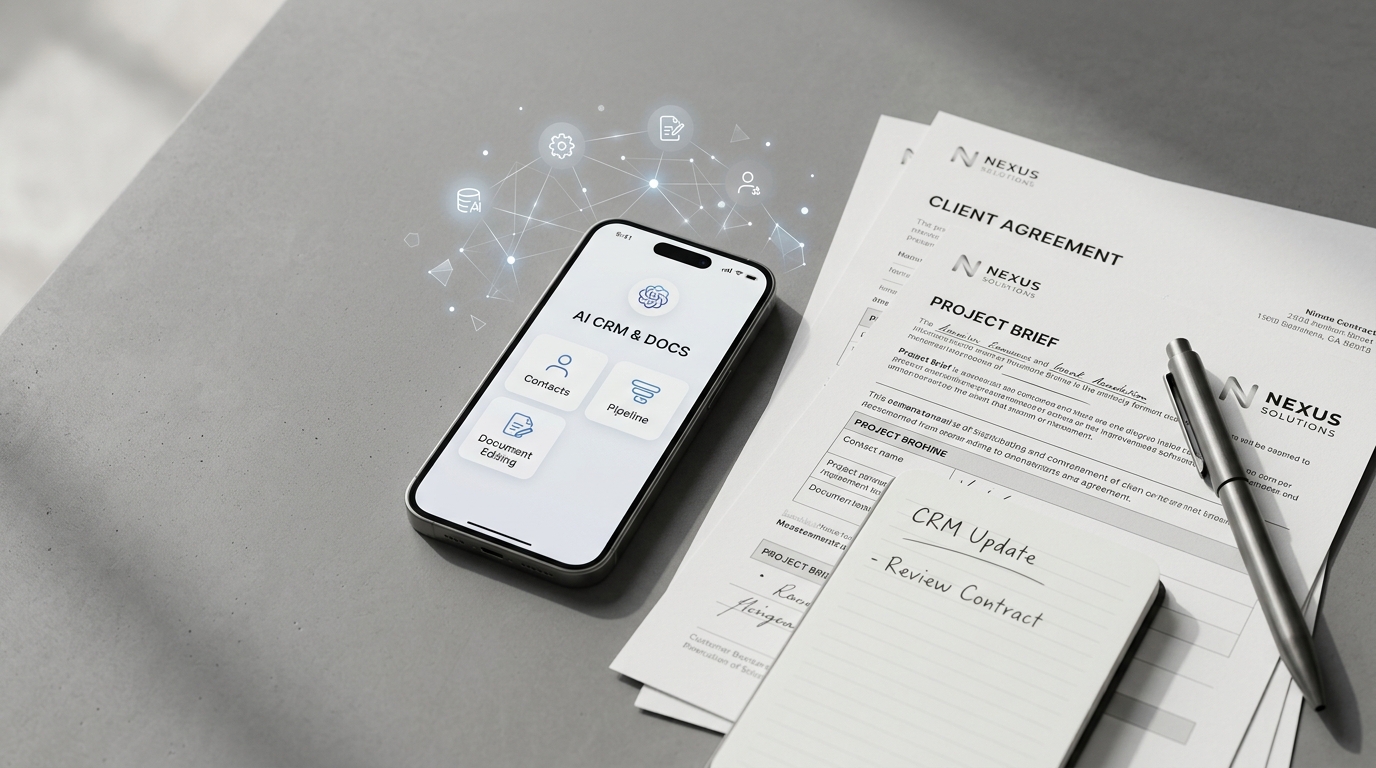

Während sich die Medien oft auf generative Bilder oder Videos konzentrieren, liegt die größte Belastung für unabhängige Profis meist im administrativen Bereich. Ein dezentrales Unternehmen zu führen erfordert die Abwicklung von Kundenkommunikation, Verträgen und Terminplanung, ohne an einen Desktop gebunden zu sein.

Beispielsweise kämpfen mobile Profis oft mit dem Dokumentenmanagement. Ein Standard-PDF-Editor auf dem Telefon ist meist umständlich und erfordert manuelles Markieren oder Formatieren. Durch die Integration lokaler Intelligenz können wir ein mobiles Tool entwickeln, das Rechnungsdaten automatisch strukturiert oder wichtige Vertragsklauseln lokal extrahiert, wodurch sensible Finanzdaten von externen Servern ferngehalten werden.

Ebenso sind traditionelle Desktop-CRM-Tools zu überladen für jemanden, der mobil arbeitet. Ein schlankes On-Device-CRM kann eingehende Kundenanfragen kategorisieren und Projektdateien basierend auf dem lokalen Kontext organisieren. Das ist es, was wir meinen, wenn wir sagen, dass die Hardware die Software überholt hat; die Geräte sind in der Lage, komplette Back-Office-Operationen auszuführen, sofern die Software-Architektur darauf ausgelegt ist.

Schritt 5: Eine belastbare, geräteagnostische Architektur einführen

Aus Sicht des Systemdesigns erfordert die Abkehr vom zentralisierten Cloud-Computing einen grundlegenden Wandel in der Art und Weise, wie Software geschrieben wird. Man muss die mobile Anwendung nicht als „Thin Client“ betrachten, der eine Webseite anzeigt, sondern als unabhängigen Microservice-Knoten.

Beim Ausrollen von Updates oder beim Anpassen von Modellgewichtungen nutzen wir modulare Architekturen. Anstatt Nutzer zum Download massiver, monolithischer Updates zu zwingen, trennen wir die Benutzeroberfläche von der Inference Engine. Dies ermöglicht es uns, leichtgewichtige, gezielte Verbesserungen an den spezifischen Modellen vorzunehmen, die Aufgaben wie Audio-Isolation oder Textkategorisierung übernehmen.

Dieser von DevOps inspirierte Ansatz für die mobile Entwicklung stellt sicher, dass unsere Anwendungen agil bleiben. Wie meine Kollegin Bilge Kurt in ihrer Analyse darüber darlegte, wie gewöhnliche mobile Hardware schwere Produktions-Workflows ersetzt, ist Effizienz die entscheidende Kennzahl für die nächste Generation von Software-Studios. Das Ziel ist es, die Leistung zu maximieren und gleichzeitig den Fußabdruck der Anwendung zu minimieren.

Schritt 6: Die langfristige Wirtschaftlichkeit von Edge Computing planen

Der letzte Schritt in unserer Roadmap-Planung beinhaltet die Analyse der langfristigen Wirtschaftlichkeit des Software-Deployments. Cloud-Computing-Kosten skalieren linear mit dem Nutzerwachstum; je erfolgreicher die App wird, desto höher steigen die Serverrechnungen. Indem wir eine Roadmap aufbauen, die auf der Verarbeitung auf dem lokalen Gerät zentriert ist, durchbrechen wir diese lineare Kostenkurve.

Diese wirtschaftliche Realität ist es, die es einem Studio ermöglicht, agil und unabhängig zu bleiben. Da wir keine massiven Serverfarmen subventionieren, können wir mehr Ressourcen in das Engineering investieren, um die User Experience zu verfeinern und unseren Code zu optimieren. Es entsteht ein nachhaltiger Zyklus, in dem die Software schneller wird, der Datenschutz gewahrt bleibt und der Nutzer die volle Kontrolle über seine tägliche digitale Umgebung gewinnt.

Die Entwicklung einer Roadmap für 2026 und darüber hinaus erfordert einen Blick über den unmittelbaren Hype-Zyklus hinaus. Es bedeutet zu erkennen, dass die wertvollste Software des nächsten Jahrzehnts die Werkzeuge sein werden, die leise, effizient und vollständig in Ihrer Handfläche laufen.