Au trimestre dernier, j'effectuais des tests de performance sur un modèle de synthèse vidéo léger que nous venions d'optimiser. Au lieu de le tester sur nos stations de travail de pointe en laboratoire, j'ai chargé la version bêta sur un iPhone 11 vieillissant. L'appareil a peiné, sans surprise : le rendu d'un clip de trois secondes a pris près de quatre minutes, et le téléphone est devenu anormalement chaud. Pourtant, observer les limites thermiques de ce matériel spécifique m'a plus appris sur la planification logicielle que n'importe quelle analyse de marché. Chez AI App Studio, un studio de développement de logiciels technologiques, notre vision ne repose pas sur ce que l'intelligence artificielle peut accomplir dans une ferme de serveurs surpuissants. Elle repose entièrement sur ce qu'elle peut exécuter entre les mains d'un utilisateur.

Pourquoi privilégier l'Edge Computing plutôt que le Cloud ?

L'edge computing dans les applications mobiles consiste à exécuter des modèles de calcul directement sur le matériel local de l'appareil plutôt que de s'appuyer sur des serveurs cloud externes. Ma position est ferme : l'avenir de l'intelligence mobile doit se situer à la périphérie (sur l'appareil).

De nombreux développeurs soutiennent que le déchargement des processus lourds vers le cloud est le seul moyen de proposer des fonctionnalités complexes sans vider la batterie ou gonfler la taille de l'application. Si cela est partiellement vrai pour les modèles fondamentaux massifs, cette dépendance introduit des latences sévères et des vulnérabilités en matière de confidentialité. Lorsqu'un utilisateur ouvre une application en attendant une utilité immédiate, un délai réseau de trois secondes pour obtenir une réponse API brise l'expérience.

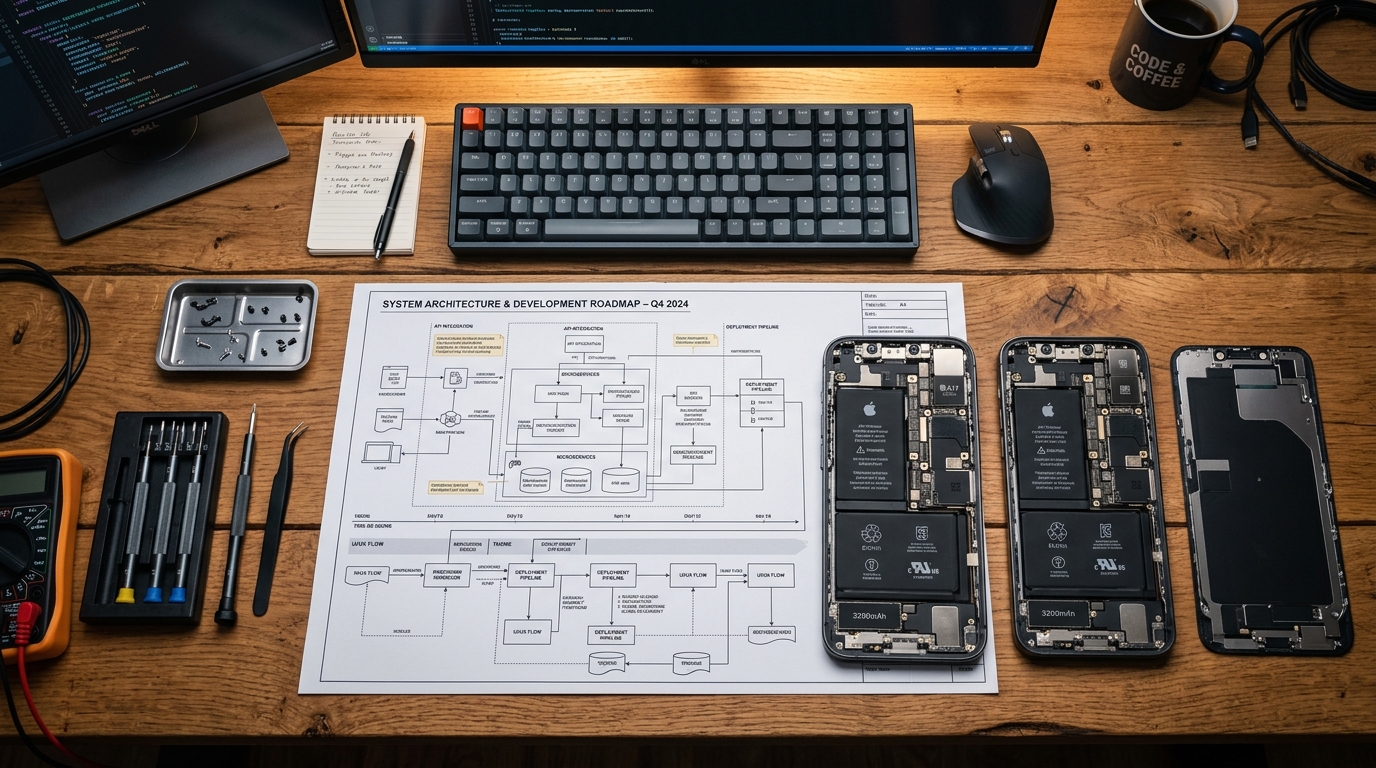

Notre feuille de route évite délibérément les simples interfaces dépendantes du cloud. Nous privilégions la création d'applications avec des modèles intégrés et dédiés qui fonctionnent hors ligne. Le véritable critère de référence de nos logiciels n'est pas leur intelligence sur une connexion fibre gigabit, mais leur fiabilité lors d'un trajet en métro sans aucun signal.

Comment la chute des coûts de production redéfinit-elle les logiciels mobiles ?

Pour comprendre l'orientation produit à long terme, il faut observer les tendances macroéconomiques de la création de médias et d'utilitaires. Selon un Rapport 2026 sur les tendances créatives de LTX Studio, l'adoption de l'IA vidéo en entreprise a augmenté de 127 % l'an dernier. Parallèlement, les coûts de production ont chuté de 91 %, réduisant les délais de plusieurs jours à quelques minutes.

Cet effondrement des coûts et du temps n'est pas seulement une métrique d'entreprise ; il influence directement les attentes des consommateurs. Si les équipes professionnelles peuvent générer et tester des actifs synthétiques en quelques minutes, les utilisateurs quotidiens s'attendent à ce que leurs outils mobiles offrent la même vitesse. De plus, les données de l'analyse de marché 2026 d'Accio prévoient que le marché global des équipements audio et vidéo atteindra 21,46 milliards USD. La frontière entre le matériel de studio professionnel et les appareils mobiles grand public est en train de disparaître.

Notre réponse à ces données est simple. Nous ne construisons pas seulement des outils de consommation ; nous construisons des environnements de production mobiles. Si un utilisateur souhaite éditer une timeline complexe ou traiter de l'audio haute fidélité, il ne devrait pas être contraint de retourner sur un ordinateur de bureau. La capacité de calcul est déjà dans sa poche ; c'est au logiciel de rattraper son retard.

Que se passe-t-il quand on conçoit l'IA pour du matériel ancien ?

Il est facile de développer un produit impressionnant lorsque votre appareil de test de base est un iPhone 14 Pro équipé d'une puce A16 Bionic. Le véritable défi technique — et notre principale contrainte de conception — consiste à créer des modèles qui s'adaptent avec fluidité aux architectures plus anciennes.

Une idée clé que nous utilisons en interne est la suivante : un excellent logiciel n'exige pas un matériel plus rapide ; il se dégrade gracieusement pour s'adapter au matériel disponible. Si nous déployons une fonction avancée de segmentation d'arrière-plan, elle doit fonctionner parfaitement sur un iPhone 14 Plus. Si cette même fonction est utilisée sur un iPhone 11, le modèle doit automatiquement basculer vers une variante plus légère. Le résultat pourra prendre un peu plus de temps ou utiliser une méthode d'échantillonnage moins agressive, mais l'application ne plantera pas.

Cette approche inclusive du matériel dicte tout notre cycle de développement. Nous passons des semaines à élaguer et quantifier les modèles pour qu'ils respectent des contraintes de mémoire strictes. En refusant d'abandonner les utilisateurs possédant du matériel plus ancien, nous forçons nos équipes d'ingénierie à écrire un code hautement optimisé plutôt que de compter sur la force brute de traitement.

Comment les applications utilitaires évoluent-elles dans un marché hybride ?

Toutes les applications ne nécessitent pas la génération de vidéo ou le rendu d'environnements 3D. Une grande partie de notre feuille de route se concentre sur l'élimination des frictions dans les tâches quotidiennes banales. Une stratégie technologique qui ignore l'utilité de base est intrinsèquement défaillante.

Prenons l'exemple de la gestion de documents. Lorsque nous intégrons des modèles de langage locaux dans un éditeur PDF, l'objectif n'est pas de créer un chatbot tape-à-l'œil. L'objectif est de permettre à un utilisateur d'extraire instantanément des clauses spécifiques d'un contrat de cinquante pages, sans avoir à télécharger des documents juridiques sensibles sur un serveur tiers.

La même logique s'applique à un CRM mobile. Les professionnels de la vente n'ont pas besoin d'un assistant IA qui essaie de rédiger leurs e-mails de zéro. Ils ont besoin de systèmes intelligents qui catégorisent automatiquement les interactions clients, enregistrent les notes de réunion hors ligne et font remonter les données historiques pertinentes précisément au moment d'un appel. D'après mon expérience, les utilisateurs rejettent l'intelligence qui tente de remplacer leur jugement, mais ils adoptent volontiers celle qui élimine les frictions administratives répétitives.

Où nous mène notre feuille de route technologique ?

Une feuille de route est une matrice de décision, pas une liste de souhaits. Comme mon collègue Doruk Avcı l'a détaillé dans un article récent sur comment un studio d'applications technologiques élabore une feuille de route produit, chaque intégration technique que nous poursuivons doit répondre directement à un besoin utilisateur documenté.

Au cours des trente-six prochains mois, nos efforts d'ingénierie porteront massivement sur le traitement local multimodal. Nous dépassons les modèles uniques de texte ou d'image. Nous étudions des frameworks permettant aux applications mobiles locales de traiter simultanément des entrées audio, textuelles et visuelles, en tirant parti du contexte global sans jamais quitter l'appareil.

En conservant le traitement sur l'appareil, en optimisant agressivement pour les diverses contraintes matérielles et en ciblant les frictions réelles des utilisateurs plutôt que le battage médiatique, nous garantissons que nos applications restent pratiques. Le cloud aura toujours sa place pour le stockage de masse et les tâches asynchrones, mais l'avenir réactif et immédiat du logiciel se joue directement sur l'appareil.