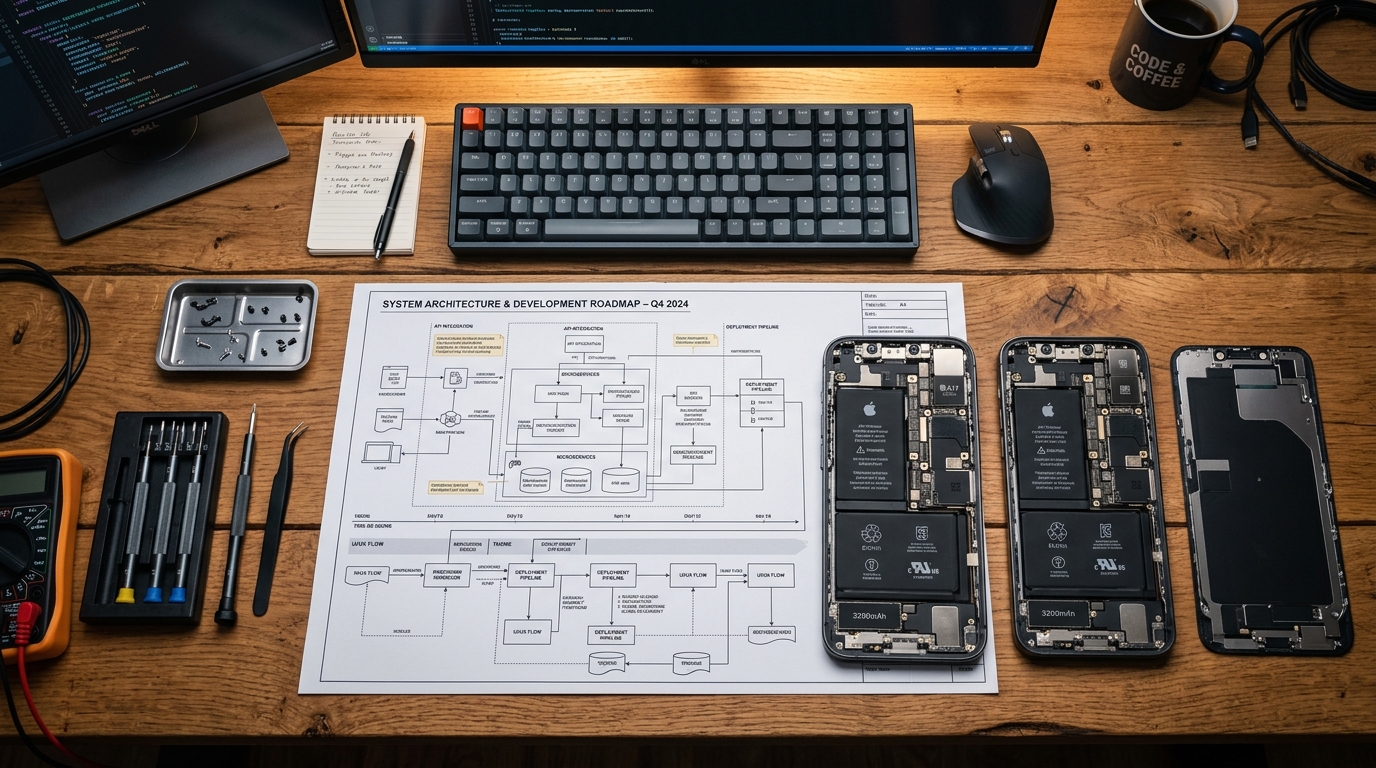

Sidste kvartal kørte jeg ydelsestests på en letvægtsmodel til videosyntese, som vi lige havde finjusteret. I stedet for at teste den på vores kraftfulde laboratorieudstyr, indlæste jeg beta-versionen på en aldrende iPhone 11. Den kæmpede, som forventet – at rendere et klip på tre sekunder tog næsten fire minutter, og enheden blev faretruende varm. Men at observere de termiske grænser for netop den hardware lærte mig mere om software-køreplaner, end nogen markedsanalyse nogensinde kunne. Hos AI App Studio, et studie der udvikler teknologifokuseret software, er vores vision ikke baseret på, hvad kunstig intelligens kan præstere i en gigantisk serverpark. Den er udelukkende baseret på, hvad den kan præstere i hænderne på en bruger.

Hvorfor bygger vi til "the edge" frem for skyen?

Edge computing i mobilapplikationer handler om at køre beregningsmodeller direkte på den lokale hardware i stedet for at forlade sig på eksterne cloud-servere til processering. Jeg har en klar holdning til dette: Fremtidens mobile intelligens skal leve på kanten – on the edge.

Mange udviklere argumenterer for, at det er nødvendigt at flytte tung databehandling til skyen for at kunne levere komplekse funktioner uden at dræne batteriet eller gøre appen enormt stor. Selvom det til dels er sandt for massive fundamentale modeller, introducerer denne afhængighed alvorlig latenstid og sårbarheder i forhold til privatlivet. Når en bruger åbner en app og forventer øjeblikkelig hjælp, ødelægger en netværksforsinkelse på tre sekunder for et API-svar hele oplevelsen.

Vores køreplan undgår bevidst tynde "cloud wrappers". Vi prioriterer at bygge applikationer med indlejrede, specialbyggede modeller, der fungerer offline. Det sande benchmark for vores software er ikke, hvor klog den er på en lynhurtig fiberforbindelse, men hvor pålideligt den performer under en pendlertur i metroen uden signal.

Hvordan omformer faldende produktionsomkostninger mobilsoftware?

For at forstå vores langsigtede produktretning skal man kigge på makrotendenserne inden for medie- og værktøjsproduktion. Ifølge en 2026-rapport om kreative tendenser fra LTX Studio steg virksomheders adoption af AI-video med 127 % i det forløbne år. Samtidig faldt produktionsomkostningerne med 91 %, hvilket forkortede tidshorisonter fra dage til minutter.

Dette fald i omkostninger og tid er ikke bare et tal til årsregnskabet; det påvirker direkte forbrugernes forventninger. Hvis professionelle teams kan generere og teste syntetiske aktiver på få minutter, forventer hverdagsbrugere, at deres mobilværktøjer tilbyder samme hastighed. Desuden forudser Accios markedsanalyse for 2026, at det bredere marked for lyd- og videoudstyr vil nå 21,46 milliarder USD. Grænsen mellem professionel studie-hardware og mobile enheder til forbrugere er ved at forsvinde.

Vores svar på disse data er ligetil. Vi bygger ikke bare værktøjer til forbrug; vi bygger mobile produktionsmiljøer. Hvis en bruger vil redigere en kompleks tidslinje eller behandle high-fidelity lyd, skal de ikke tvinges tilbage til en desktop-computer. Beregningskapaciteten ligger allerede i deres lomme; softwaren skal blot indhente den.

Hvad sker der, når man bygger kunstig intelligens til ældre hardware?

Det er let at udvikle et imponerende produkt, hvis din baseline-enhed er en iPhone 14 Pro udstyret med en A16 Bionic-chip og masser af Neural Engine-kerner. Den reelle tekniske udfordring – og vores primære designbegrænsning – er at skabe modeller, der skalerer elegant på tværs af ældre arkitektur.

En central indsigt, vi bruger internt, er denne: Den bedste software kræver ikke hurtigere hardware; den tilpasser sig elegant den hardware, den har til rådighed. Hvis vi udruller en avanceret funktion til baggrundssegmentering, skal den køre fejlfrit på en iPhone 14 Plus. Hvis den samme funktion tilgås på en iPhone 11, skal modellen automatisk skifte til en lettere variant. Resultatet tager måske lidt længere tid eller bruger en mindre aggressiv metode, men applikationen crasher ikke.

Denne hardware-inkluderende tilgang dikterer hele vores udviklingscyklus. Vi bruger ugevis på at beskære og kvantisere modeller, så de passer inden for strenge hukommelsesbegrænsninger. Ved at nægte at opgive brugere med ældre hardware tvinger vi vores ingeniørteams til at skrive højt optimeret kode i stedet for at stole på rå processorkraft.

Hvordan udvikler værktøjsapps sig i et hybridmarked?

Ikke alle apps kræver videogenerering eller 3D-rendering. Meget af vores køreplan fokuserer på at fjerne gnidninger i trivielle hverdagsopgaver. En teknologisk køreplan, der ignorerer basale værktøjer, er fundamentalt mangelfuld.

Tag for eksempel dokumenthåndtering. Når vi integrerer lokale sprogmodeller i en PDF-editor, er målet ikke at skabe en prangende chatbot. Målet er at give brugeren mulighed for at udtrække specifikke klausuler fra en halvtreds sider lang kontrakt øjeblikkeligt, uden at uploade følsomme juridiske dokumenter til en tredjepartsserver.

Samme logik gælder for en mobil CRM. Sælgere har ikke brug for en AI-assistent, der prøver at skrive deres e-mails fra bunden. De har brug for intelligente systemer, der automatisk kategoriserer kundeinteraktioner, logger noter fra offline-møder og fremdrager relevante historiske data præcis, når et opkald kommer ind. Efter min erfaring afviser brugere intelligens, der prøver at erstatte deres dømmekraft. De tager derimod med kyshånd imod intelligens, der fjerner gentagende administrativt besvær.

Hvor fører vores teknologifokuserede køreplan os hen nu?

En køreplan er en beslutningsmatrix, ikke en ønskeliste. Som min kollega Doruk Avcı beskrev i et nyligt indlæg om, hvordan et teknologifokuseret app-studie opbygger en produktkøreplan, skal enhver teknisk integration kunne kobles direkte til et dokumenteret brugerbehov.

Over de næste 36 måneder vil vores ingeniørfokus i høj grad ligge på lokal multimodal behandling. Vi bevæger os ud over enkelte tekst- eller billedmodeller. Vi forsker i frameworks, der gør det muligt for lokale mobilapps at behandle lyd, tekst og visuelle input samtidigt, så de kan drage kontekst af hinanden uden at forlade enheden.

Ved at holde processeringen på enheden (the edge), optimere aggressivt til varierende hardware og målrette os mod reel brugerfriktion frem for branche-hype, sikrer vi, at vores applikationer forbliver praktiske. Skyen vil altid have sin plads til lagerplads og asynkrone opgaver, men den umiddelbare, responsive fremtid for software sker lige her på enheden.