В прошлом квартале я проводил тесты производительности облегченной модели видеосинтеза, которую мы только что доработали. Вместо того чтобы тестировать ее на наших флагманских лабораторных мощностях, я загрузил бета-версию на старенький iPhone 11. Смартфон, как и ожидалось, «захлебнулся»: рендеринг трехсекундного клипа занял почти четыре минуты, а само устройство стало пугающе горячим. Однако наблюдение за термическими пределами этого конкретного железа научило меня планированию программных продуктов больше, чем любой рыночный анализ. В AI App Studio — студии, создающей технологически ориентированное ПО, — наше видение основывается не на том, что искусственный интеллект может совершить в мощном серверном кластере. Оно полностью строится на том, что он может выполнить в руках обычного человека.

Почему мы ориентируемся на Edge-вычисления, а не на облако?

Edge-вычисления (вычисления на периферии) в мобильных приложениях — это практика запуска вычислительных моделей непосредственно на локальном оборудовании устройства, а не на внешних облачных серверах. Моя позиция здесь тверда: будущее мобильного интеллекта должно жить «на краю».

Многие разработчики утверждают, что перенос тяжелой обработки в облако — единственный способ реализовать сложные функции, не разряжая аккумулятор и не раздувая размер приложения. Хотя это отчасти верно для массивных базовых моделей, такая зависимость создает серьезные задержки и уязвимости в защите данных. Когда пользователь открывает приложение в ожидании мгновенного результата, трехсекундная сетевая задержка при получении ответа по API портит всё впечатление.

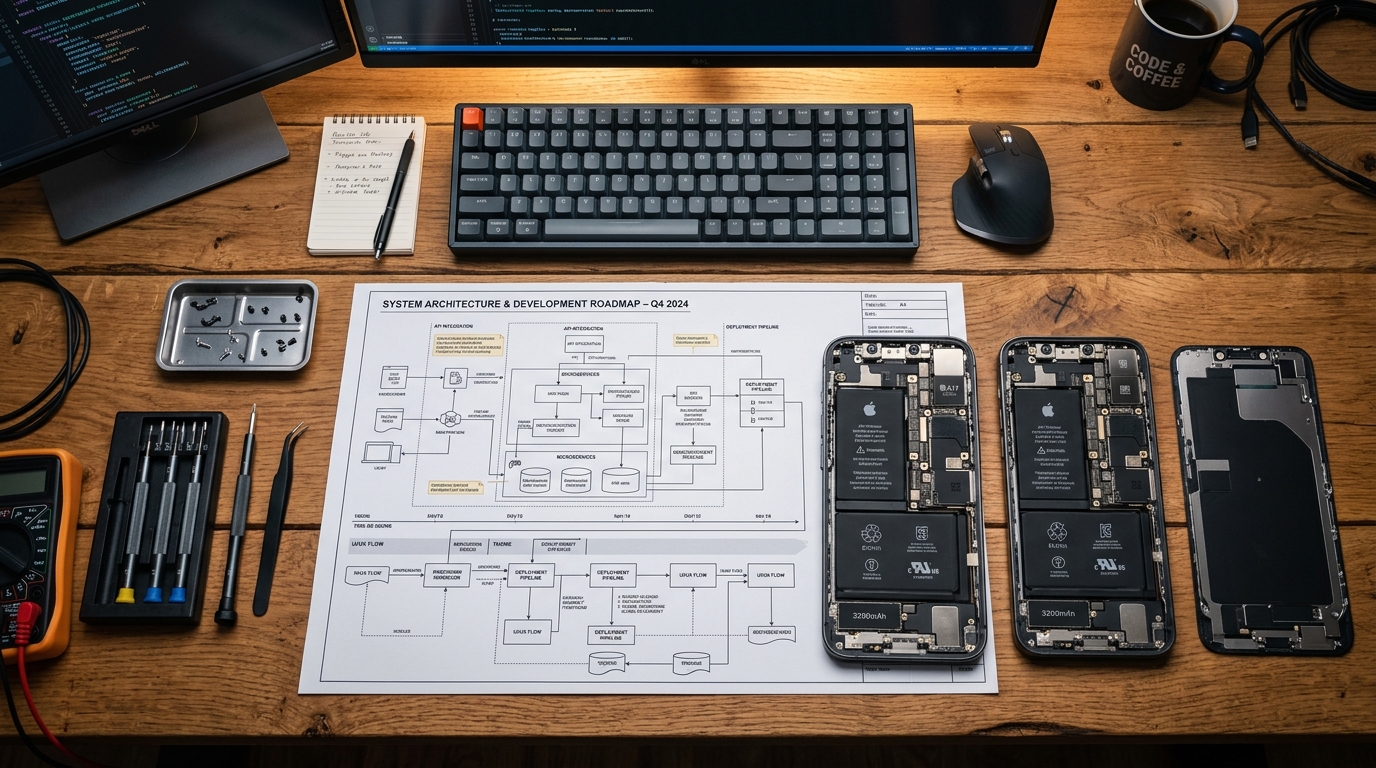

Наша дорожная карта намеренно избегает создания простых облачных «оболочек». Мы отдаем приоритет разработке приложений со встроенными, специализированными моделями, которые работают в автономном режиме. Настоящий показатель качества нашего софта — не то, насколько он «умен» при гигабитном оптоволоконном соединении, а то, насколько надежно он работает в вагоне метро при полном отсутствии сигнала.

Как снижение стоимости производства меняет мобильное ПО?

Чтобы понять направление нашего долгосрочного развития, нужно взглянуть на макротренды в создании контента и утилит. Согласно Отчету о креативных трендах 2026 от LTX Studio, внедрение корпоративного видео-ИИ выросло на 127% за последний год. В то же время производственные затраты упали на 91%, сократив сроки выполнения задач с нескольких дней до минут.

Этот обвал стоимости и времени — не просто корпоративная метрика; он напрямую влияет на ожидания потребителей. Если корпоративные команды могут генерировать и тестировать синтетические активы за считанные минуты, обычные пользователи ждут такой же скорости от своих мобильных инструментов. Более того, данные из рыночного анализа Accio за 2026 год прогнозируют, что рынок аудио- и видеооборудования достигнет 21,46 млрд долларов США. Граница между профессиональным студийным железом и потребительскими мобильными устройствами стирается.

Наш ответ на эти данные прост: мы создаем не просто инструменты для потребления контента, а мобильные среды для его производства. Если пользователь хочет отредактировать сложную временную шкалу или обработать высококачественный звук, он не должен быть вынужден возвращаться к настольному ПК. Вычислительная мощность уже находится у него в кармане; программному обеспечению просто нужно ее догнать.

Что происходит, когда создаешь ИИ для устаревающего железа?

Легко разработать впечатляющий продукт, когда ваше базовое тестовое устройство — iPhone 14 Pro с чипом A16 Bionic и кучей ядер Neural Engine. Настоящий инженерный вызов (и наше главное проектное ограничение) — создание моделей, которые корректно масштабируются на старой архитектуре.

У нас есть внутренний принцип: лучшее ПО не требует более мощного железа — оно «грациозно деградирует», адаптируясь к тому оборудованию, которое есть. Если мы внедряем функцию продвинутой сегментации фона, она должна безупречно работать на iPhone 14 Plus. Если же к этой функции обращаются с iPhone 11, модель должна автоматически переключаться на облегченный вариант. Результат может занять чуть больше времени или использовать менее агрессивный метод выборки, но приложение не должно вылетать.

Этот инклюзивный подход к оборудованию определяет весь наш цикл разработки. Мы неделями занимаемся прунингом и квантованием моделей, чтобы они вписывались в жесткие ограничения оперативной памяти. Отказываясь бросать пользователей со старыми устройствами, мы заставляем наших инженеров писать высокооптимизированный код, а не полагаться на грубую вычислительную силу.

Как эволюционируют сервисные приложения на гибридном рынке?

Не каждое приложение требует генерации видео или рендеринга 3D-сцен. Большая часть нашей дорожной карты сфокусирована на устранении барьеров в повседневных задачах. Технологический план, игнорирующий базовую пользу, в корне неверен.

Возьмем, к примеру, управление документами. Когда мы интегрируем локальные языковые модели в PDF-редактор, цель состоит не в создании броского чат-бота. Цель — позволить пользователю мгновенно извлечь конкретные пункты из пятидесятистраничного контракта без загрузки конфиденциальных юридических документов на сторонний сервер.

Та же логика применима к мобильным CRM. Специалистам по продажам не нужен ИИ-помощник, который пытается писать письма с нуля. Им нужны интеллектуальные системы, которые автоматически классифицируют входящие взаимодействия с клиентами, протоколируют заметки со встреч в офлайне и выводят релевантные исторические данные именно в момент звонка. По моему опыту, пользователи отвергают интеллект, который пытается заменить их суждение. Они с радостью принимают интеллект, который избавляет их от рутинной административной работы.

Куда приведет наша технологическая стратегия дальше?

Дорожная карта — это матрица решений, а не список пожеланий. Как подробно описал мой коллега Дорук Авджи в недавнем посте о том, как студия разработки, ориентированная на технологии, строит дорожную карту продукта, каждая техническая интеграция должна напрямую отвечать задокументированным потребностям пользователя.

В ближайшие три года фокус наших инженеров будет смещен в сторону мультимодальной локальной обработки. Мы выходим за рамки отдельных текстовых или визуальных моделей. Мы исследуем фреймворки, которые позволяют локальным мобильным приложениям одновременно обрабатывать аудио, текст и визуальные данные, черпая контекст друг из друга без передачи данных за пределы устройства.

Сохраняя обработку данных на устройстве, агрессивно оптимизируя ПО под различные аппаратные ограничения и ориентируясь на реальные проблемы пользователей, а не на индустриальный хайп, мы гарантируем практичность наших приложений. Облако всегда будет иметь свое место для массового хранения и асинхронных задач, но мгновенное, отзывчивое будущее софта создается прямо на вашем устройстве.